Hate Media: siete de cada 10 mensajes de odio en las redes son políticos

La Universidad Internacional de La Rioja (UNIR), junto a otras seis instituciones de España, desarrolla un algoritmo para detectar mensajes de odio en redes sociales, que podrá usarse en América Latina.

Imagen referencial de una mujer leyendo un celular con mensajes ofensivos.

AFP / Primicias

Autor:

Actualizada:

Compartir:

La guerra de Israel contra el grupo radical Hamás ha puesto contra las cuerdas la capacidad de Facebook, Instagram y la red social X, que no han podido parar el 'hate media' o mensajes de odio en sus plataformas.

Discursos y expresiones contra judíos y palestinos se han expandido a un ritmo alarmante, junto a las noticias falsas, durante el conflicto en Medio Oriente.

¿Cómo parar el discurso de odio 'virtual'? Siete universidades de España, incluyendo UNIR (Universidad Internacional de La Rioja), recurren a la tecnología, la matemática y la inteligencia artificial, para desarrollar el proyecto 'Hate Media', que identifica estos mensajes e insultos en medios virtuales y en redes.

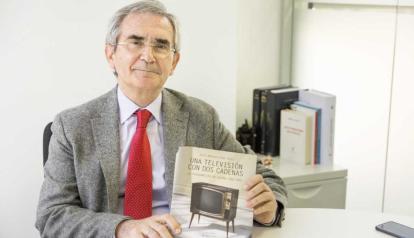

"Lo que permite el algoritmo de hate media son diagnósticos precoces de situaciones potencialmente peligrosas", dice el profesor de Unir y coinvestigador del proyecto, Julio Montero.

En entrevista con PRIMICIAS, el profesor Montero explica cómo desarrollan el proyecto y qué esperan lograr.

¿En qué se diferencia el 'hate media' del bullying?

El bullying o acoso digital son acciones, mientras que el 'hate media' son palabras y expresiones de odio.

Pero este odio se puede traducir en palabras y acciones en la vida real.

¿Pero ambos conceptos tienen relación?

Esta relación es una de las cosas que deseamos saber con el proyecto de 'hate media' de UNIR, porque se habla mucho de que el desprecio se traduce luego en acciones, y esto sí puede ocurrir.

Pensamos que ocurren, en algunos casos, cuando son expresiones de odio muy discriminatorias, y en otras se quedan en prejuicios y estereotipos en la vida online.

¿En qué etapa se encuentra el proyecto de hate media?

Con el algoritmo, podemos detectar mensajes en versiones digitales de medios y redes sociales, en concreto X y Facebook, bien sean expresiones de odio por orientación sexual, de género o lugar de procedencia.

Ya tenemos un primer nivel de desarrollo del algoritmo, que detecta mensajes de odio muy bien, y estamos a punto de cerrar esta primera versión.

"En menos de un mes seremos capaces de detectar cuáles son las tipologías de odio, es decir, a quién odia la gente en redes sociales, o qué se odia más".

Julio Montero, profesor de la Universidad UNIR.

Esto le ofrecerá a las autoridades un instrumento para poder actuar, pero también podremos en el futuro conocer cuáles son las actitudes que canalizan el odio y sus intensidades. Seremos capaces de valorar qué es más peligroso, si 1.000 insultos o una amenaza de muerte.

¿Cómo lograron desarrollar este algoritmo?

Especialistas en Informática y Matemáticas trabajaron el algoritmo sobre las bases de un equipo de lingüistas, abogados y especialistas en comunicación.

También se utiliza inteligencia artificial, lo que permite al algoritmo realizar diagnósticos precoces de situaciones potencialmente peligrosas, pero quien debe tomar las medidas son las instituciones públicas y no los académicos.

¿Parar el 'hate media' depende del Estado?

Cuando se trata de establecer límites legales, de lo que es o no permitido, ya es un trabajo de las instituciones públicas. Es decir, fundamentalmente de las instituciones políticas que ejercen el poder y son las que definen lo que es legal.

¿Cuáles son los principales mensajes de odio que han encontrado?

En España, que es donde hemos podido probar el algoritmo y podemos hablar con certeza, es que el odio más extendido es el de enfrentamientos políticos.

Siete de cada 10 mensajes de odio son de temas políticos y eso se debe a la extrema polarización que tenemos.

Sin quitar importancia a otras expresiones de odio, porque los que sufren el mensaje son afectados, el siguiente tipo más común es el odio contra la mujer o de género.

Luego le siguen mensajes de odio por motivos de inmigración.

¿Podrá ser utilizado el algoritmo y el proyecto en otros países?

Por ahora se ha aplicado en España, pero podría aplicarse sin dificultad en países que hablen castellano, como en América Latina.

Habrá que hacer ajustes en cada una de las regiones, pero serán mínimos. En otras lenguas, tendríamos que trabajar con las bases que tenemos, con los discursos y palabras que encierran odio, pero en otro idioma.

Si bien el concepto de odio es absoluto y universal, la forma de expresar ese odio de manera oral varía ligeramente.

¿Existe al momento en redes una línea muy delgada entre odio y libertad de expresión?

Sí, hay esa línea delgada que está marcada por la ética, es decir, puedo pensar libremente lo que quiera, pero mi pensamiento no puede atentar contra la libertad del otro o la vida de otros.

En el antiguo gobierno nazi era legítimo expresar mensajes antisemitas y era fomentado por el mismo gobierno, pero moralmente es reprochable y nadie puede ser disculpado por aquello.

Compartir: